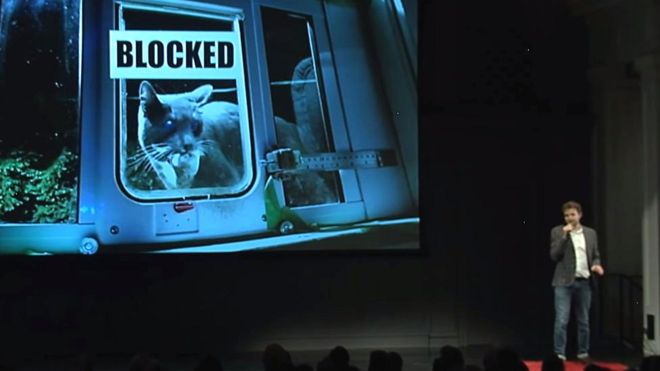

Una solapa de gato que automáticamente impide la entrada a una mascota si intenta entrar con una presa en sus mandíbulas ha sido construida como un proyecto de bricolaje por un empleado de Amazon.

Ben Hamm utilizó un software de aprendizaje automático para entrenar a un sistema a reconocer cuando su gato Metric se acercaba con un roedor o un pájaro en la boca.

Cuando detectó tal ataque, dijo, una computadora conectada a la cerradura de la tapa provocó un apagón de 15 minutos.

El Sr. Hamm presentó su invento en un evento en Seattle el mes pasado.

La presentación fue posteriormente sacada a la luz por el sitio de noticias tecnológicas The Verge.

Muertes etiquetadas

El Sr. Hamm utilizó dos de las herramientas de Amazon para lograr su objetivo:

DeepLens – una cámara de vídeo diseñada específicamente para ser utilizada en experimentos de aprendizaje por ordenador.

Sagemaker – un servicio que permite a los clientes comprar algoritmos de terceros o construir los suyos propios, luego entrenarlos y ajustarlos con sus propios datos, y finalmente ponerlos en uso.

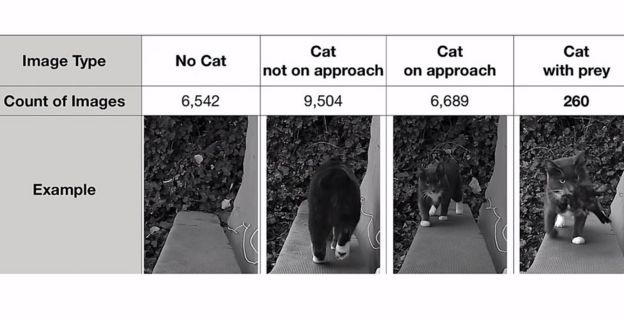

Explicó que la parte más lenta de la tarea había sido la necesidad de suministrar más de 23.000 fotografías.

Cada uno tenía que ser clasificado a mano para determinar si el gato estaba a la vista, si iba o venía y si llevaba presas.

El proceso se aprovechó de una técnica llamada aprendizaje supervisado, en la cual una computadora es entrenada para reconocer patrones en imágenes u otros datos suministrados a través de etiquetas dadas a los ejemplos. La idea es que una vez que el sistema tenga suficientes ejemplos para trabajar, puede aplicar las mismas etiquetas a los nuevos casos.

Una de las limitaciones de la técnica es que a veces se necesitan cientos de miles o incluso millones de ejemplos para que estos sistemas sean fiables.

El Sr. Hamm reconoció que en este caso los resultados no eran 100% exactos.

Durante un período de cinco semanas, recordó, Metric estuvo injustamente bloqueado una vez. Además, el gato también pudo entrar una de las siete veces que había atrapado a una víctima.

Pero cuando un ingeniero de software sugirió que podría haber sido más fácil enseñar a su gato a cambiar su comportamiento que a entrenar un modelo de ordenador, el Sr. Hamm defendió su trabajo.

“El refuerzo negativo no funciona para los gatos, y te reto a que encuentres una forma de usar las recompensas para prevenir un comportamiento que un animal exhibe una vez cada 10 días a las 3 de la madrugada”, dijo tuiteando en respuesta.

Esta no es ni mucho menos la única vez que se ha utilizado la tecnología de aprendizaje automático para tratar de ayudar a los dueños de gatos.

Otro trabajador de Amazon reveló recientemente que había usado un sistema similar para tratar de evitar que su gato se sentara en la mesa de su sala de estar.

Mientras tanto, los desarrolladores de Microsoft compartieron previamente detalles de una solapa de gato inteligente que habían construido y que utilizaba tecnología de reconocimiento facial para reconocer a la mascota del propietario, pero que bloqueaba el acceso a otros animales.

Tecnología arriesgada

Un experto dijo a la BBC que el rápido despliegue de las herramientas de inteligencia artificial basadas en la nube por parte de los gigantes de la tecnología significaba que tales experimentos podían ser llevados a cabo por un número cada vez mayor de personas.

“Amazon, Google y Microsoft han hecho mucho más fácil el uso de la IA al proporcionar servicios como Sagemaker, que necesitan poca o ninguna habilidad de codificación para su uso”, dijo Martin Garner, de la consultora CCS Insight.

“Pero’democratizar la IA’, para que cualquiera pueda utilizarla, es tan arriesgado como democratizar la odontología – lo que el mundo necesita realmente son ingenieros de IA mejor formados”.

En particular, ha existido la preocupación de que la tecnología de reconocimiento de imágenes se esté utilizando en seres humanos antes de que los legisladores hayan tenido la oportunidad de considerar adecuadamente las implicaciones.

Recientemente, Amazon fue criticada por permitir que las fuerzas policiales estadounidenses utilizaran Rekognition, otra de sus herramientas de aprendizaje a máquina, para identificar a los sospechosos, a pesar de la preocupación de que los agentes no siempre siguieran sus directrices sobre las mejores prácticas.

Y el comisario de cámaras de vigilancia del Reino Unido advirtió recientemente que el reconocimiento facial podría utilizarse para crear una “sociedad distópica” en la que se siga regularmente a los ciudadanos cada vez que abandonan sus hogares.

Añadir comentario